추론형 AI에서 SSD는 자주 펼쳐 보는 참고서 같은 것

작성자 정보

- 김프로 작성

- 작성일

본문

문맥 잇는 ‘확장 메모리’… HBM 대비 수십~수백 배 이상 필요

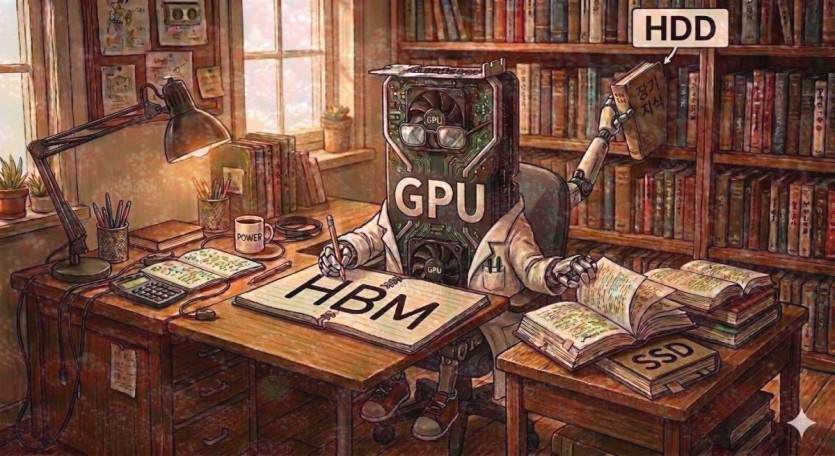

추론형 인공지능(AI)의 데이터 처리 과정은 GPU(그래픽처리장치)라는 연구자가 책상 위 메모장, 보조 책상 위 참고 자료, 책장 속 책을 오가며 작업을 이어가는 모습에 비유할 수 있다. 제미나이 생성 이미지

단순한 생성형 인공지능(AI)을 넘어 사고하는 추론형(Reasoning)으로 AI 활용의 중심축이 빠르게 이동하고 있다. 2022년 말부터 시작된 초기 챗GPT 기반 AI 모델은 입력할 프롬프트를 잘 선택해 AI 모델로부터 즉각적인 응답을 유도하는 데 초점을 맞췄다. 이러한 프롬프트 기반 AI는 방금 입력한 질문과 제한된 대화 기록을 바탕으로 동작하기 때문에 응답이 지속적으로 연결되기 어렵고 매번 계산을 새로 하는 구조에 가까웠다.

반면 추론 AI는 과거 경험, 현재 상황, 목표 변화, 외부 정보 등 많은 정보를 참고하고 이들을 지속적으로 고려해 응답한다. 유지된 기억인 문맥에 기반해 여러 단계로 나눠 심사숙고하도록 발전했다. 즉 추론 AI는 사용자와의 대화를 통해 다듬어진 경험이 주어진 상황에 맞게 발휘되는 것이다.

GPU는 연구자, HBM은 메모장 역할이러한 추론 AI 구조를 연구자가 책상에서 작업하는 모습에 비유해볼 수 있다. 먼저 GPU(그래픽처리장치)는 연구자다. HBM(고대역폭메모리)은 연구자가 현재 생각을 적고 있는 책상 위 메모장에 해당한다. SSD(솔리드스테이트드라이브) 스토리지는 자주 참고해야 해서 책상 위에 펼쳐두거나 책상 옆 보조 책상에 올려둔 책들이다. 마지막으로 HDD(하드디스크) 스토리지나 클라우드에 있는 객체 스토리지는 오랫동안 모은 방대한 기초 자료로서 책장에 보관된 수많은 책이라고 생각하면 된다.

프롬프트 기반 AI는 메모장에 적힌 현재 질문만 보고 답하는 방식으로, 맥락을 이어가는 흐름이 쉽게 끊기게 된다. 반면 문맥에 기반한 추론 AI는 책상 위 메모장뿐 아니라, 함께 살펴볼 수 있도록 가까이에 가져다 둔 책들까지 동시에 활용해 사고하는 모습에 가깝다. 연구자는 여러 추론 AI 작업을 병행하면서 메모장과 펼쳐 봤던 책을 잠시 옆 보조 책상에 두었다가 다시 가져와 작업을 이어가기도 한다.

정리해보면 추론 AI는 먼저 메모장(HBM)에서 현재 추론과 작업 상태 기록을 진행한다. 그 과정에서 필요한 최근 대화 기록과 문맥 정보는 펼쳐둔 책(SSD)에서 빠르게 가져온다. 오래된 기록이나 장기 지식을 포함한 방대한 데이터 정보는 책장(HDD 또는 클라우드)에서 찾아와 중요한 내용을 다시 메모장에 정리하며 사고를 이어간다.

최신 AI 데이터센터를 통해 서비스되는 추론 AI는 메모리와 스토리지를 계층적으로 활용하면서 '계산(Inference)-상황 기억(Context Memory)-장기 지식(Storage)'을 통합하는 구조로 발전하고 있다. GPU와 HBM으로 계산하고, 일반 메모리와 SSD 플래시 메모리 기반의 킷값(Key-Value) 캐시 및 벡터 데이터베이스로 문맥을 유지한다. 또한 멀리 위치한 대규모 HDD 및 클라우드 스토리지와 연계해 대량의 장기 지식 데이터를 관리한다. 이러한 데이터 중심의 계층적 구조는 매우 빠른 초고속 네트워크와 통합돼 발전하고 있다.

추론 AI는 이제 계산의 빠르기가 아니라 기억의 효율성을 두고 경쟁하고 있다. 이러한 변화의 일차적 수혜자는 GPU를 위한 전용 내부 메모리 역할을 담당하는 HBM이다. D램을 적층해 제조되는 HBM에 대한 수요 폭증과 이에 따른 D램 공급 부족은 최고 10배 수준에 도달한 전무후무한 메모리 가격 폭등을 초래하고 있다.

그리고 이제는 SSD 수요도 폭발적으로 늘어나는 추세다. 문맥이 이어지도록 하는 데 필요한 모든 데이터를 GPU와 HBM에 상주시키기가 어려워 '확장 메모리' 역할을 하는 SSD에 넣어두기 시작한 것이다. 최신 추론 AI 서버에서 GPU 1장에 붙는 HBM 용량은 약 80~192GB(기가바이트) 수준이지만 이를 문맥 수준에서 지원하는 SSD는 수 TB(테라바이트) 혹은 수십 TB 규모로 구성되고 있다. 실제 추론 AI 인프라는 HBM 대비 SSD 용량이 수십~수백 배 이상 필요한 방향으로 발전한 것이다.

그 결과 메모리 가격 폭등과 유사하게 SSD 가격도 인상되고 있다. 2024년 낸드플래시 감산, 2025년 AI 데이터센터 확대와 클라우드 사업자들의 선구매에 따른 공급 부족 심화, 올해 추론 AI 본격화 등 요인으로 일반 SSD 가격은 과거 대비 2~3배, 고성능 SSD는 4~5배 높아진 상황이다.

AI 에이전트로 메모리, 스토리지 수요 폭증메모리와 스토리지 수요 폭증 배경에는 AI 에이전트 확산도 있다. AI 에이전트는 '스스로 기억하고 함께 일하는 디지털 연구원'과 같다. AI 에이전트는 HBM에서 현 작업을 추론하고, SSD에서 필요한 문맥을 가져오며, 스토리지에서 오래된 정보를 검색한다. 이 과정에서 발생하는 메모리와 스토리지 사용량 확대는 멈추지 않을 것만 같아 보인다.

AI 파운데이션 모델과 자율 지향 에이전트에 기반해 심화하는 AI 추론 능력은 다양한 분야에 특화된 데이터를 축적하고 또 이 데이터들을 융합하면서 부가가치 생태계를 확산하고 있다. 이러한 과정을 지원하도록 계층화된 메모리와 스토리지 구조는 전 세계적인 데이터 연합을 효율화하면서 지속적으로 구조적 변화를 만들어가고 있다.

김종원 광주과학기술원(GIST) AI대학원 원장

*유튜브와 포털에서 각각 ‘매거진동아’와 ‘투벤저스’를 검색해 팔로잉하시면 기사 외에도 동영상 등 다채로운 투자 정보를 만나보실 수 있습니다.

Copyright © 주간동아. All rights reserved. 무단 전재, 재배포 및 AI학습 이용 금지

관련자료

-

이전

-

다음

댓글 0

등록된 댓글이 없습니다.